El uso de la inteligencia artificial (IA) se ha disparado en los últimos meses, y el realismo que pueden alcanzar estas creaciones hace que no podamos estar seguros, a primera vista, de si el contenido que se está difundiendo es real o no. A pesar de la aparente autenticidad de las imágenes, hay que fijarse en los detalles. Las imágenes generadas por IA suelen fallar en algunos aspectos, como es poca nitidez en zonas como las manos o las orejas, elementos distorsionados, desproporcionados o con texturas extrañas, o fondos borrosos.

Por ello, en Maldita.es hemos recopilado algunas de las imágenes generadas con IA que se han viralizado como reales para que no os la cuelen.

Si os llega una imagen de la que sospecháis, podéis hacérnoslo llegar a través de nuestro chatbot de WhatsApp (+34 644 229 319) para que lo verifiquemos.

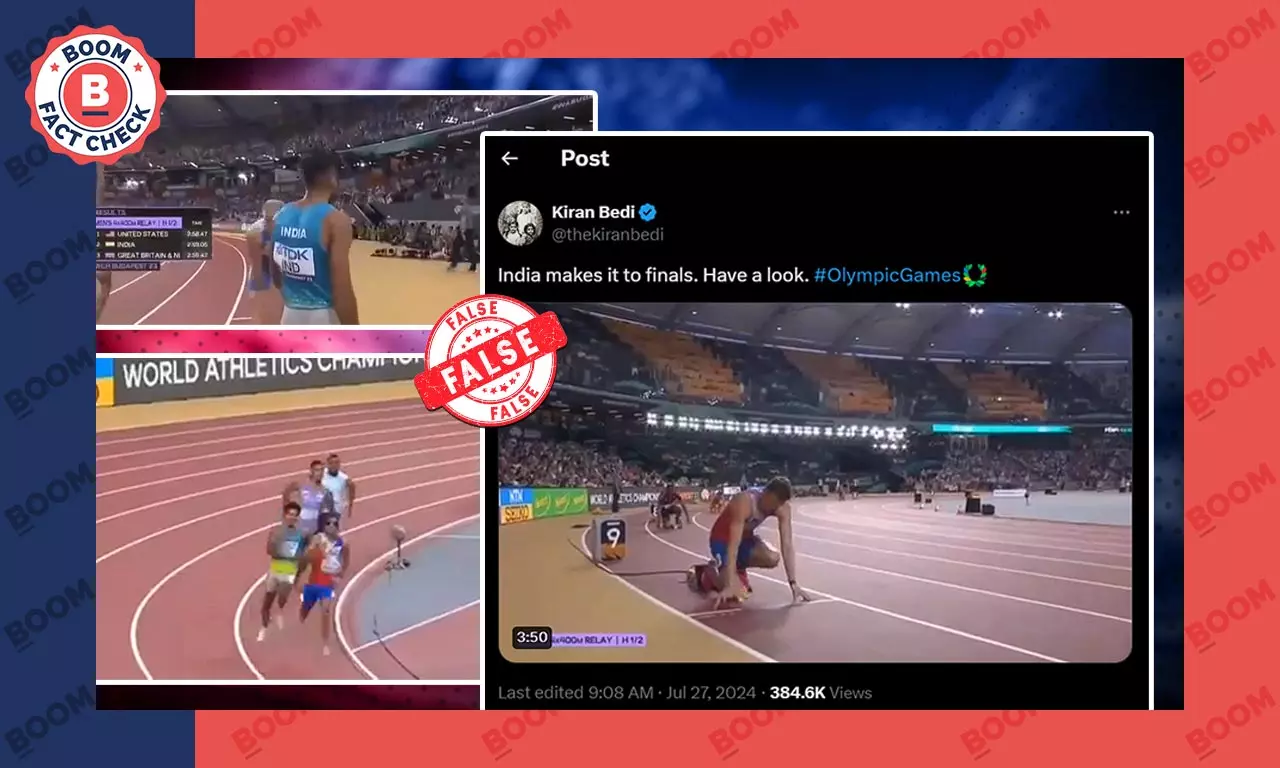

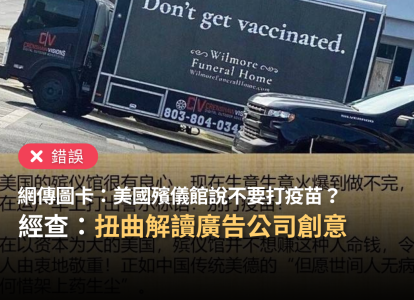

Las fotos de Donald Trump huyendo de la policía para no ser arrestado: han sido creadas con inteligencia artificial, pero se viralizan como reales

Las fotos de Donald Trump siendo arrestado por la policía no son reales, aunque lo parezcan. Son imágenes creadas con inteligencia artificial, coincidiendo con la investigación de un presunto pago de dinero a la actriz porno Stormy Daniels a cambio de su silencio durante la campaña de las elecciones de 2016 que llevaron a Trump a la Casa Blanca. Pese a que medios como El País indicaron que podría ser imputado “en cualquier momento” por la fiscalía, las imágenes del expresidente de EEUU tratando de zafarse de la policía no son reales. Además, Trump había dicho que iba a ser arrestado justo el día que se difundieron las imágenes.

Las fotos fueron publicadas por Eliot Higgins, responsable del medio de investigación Bellingcat, con la inteligencia artificial Midjourney v5, cuya última versión fue lanzada en marzo de 2023.

Las imágenes del papa Francisco con un abrigo de plumas blanco han sido creadas con inteligencia artificial y no son reales

“Mira: El Papa Francisco ha dividido opiniones entre los cristianos tras aparecer con un look a la moda. ¿Funcionó?”. Una imagen del papa Francisco caminando por la calle con un abrigo de plumas blanco se ha hecho viral en Twitter como si fuera real. Pero es un bulo: está creada con inteligencia artificial (IA) y no es real. La imagen fue publicada el 24 de marzo de 2023 en el subforo de Reddit r/midjourney y está elaborada con el programa de inteligencia artificial que le da nombre al subforo, Midjourney. También se ha difundido como real en otras redes sociales como Twitter.

No son las únicas imágenes del papa que se han compartido: también se han generado imágenes con IA en las que se puede ver al papa Francisco con un traje de chaqueta verde, un abrigo naranja y un traje papal con estampado geométrico de distintos colores, y haciendo distintas poses.

No, esta imagen de Putin arrodillado ante Xi Jinping no es real: está generada con inteligencia artificial

“Putin arrodillado ante Xi Jing Pin. Su héroe, pinches macuarros”. Se está difundiendo en Twitter como si fuera real una supuesta imagen del presidente ruso Vladimir Putin arrodillado ante el presidente chino Xi Jinping durante la visita del mandatario chino en Moscú que tuvo lugar del 20 al 22 de marzo de 2023. Pero es un bulo: la imagen ha sido generada por inteligencia artificial.

Detalles como el tamaño del zapato, deformidades en la cabeza de Putin o poca nitidez en las manos indican que no es una imagen real. Al buscar la imagen en Google, no hay rastro de ella en ningún medio de comunicación o portal de imágenes oficiales.

Cómo una imagen creada con inteligencia artificial se viralizó como si fuera una foto real de una manifestación en Francia

En los días de la manifestación contra la reforma de las pensiones en Francia, circularon por redes sociales unas fotografías de unos supuestos antidisturbios abrazando a mujeres. Sin embargo, estas imágenes no son reales: se trata de tres imágenes generadas con inteligencia artificial (IA). El usuario que las ha difundido dice haberlo hecho para “concienciar sobre los efectos adversos” de esta técnica. En este caso, para detectarlo podemos reparar en la textura de la piel de las personas o en el fondo borroso de las imágenes.

1 year ago

43

1 year ago

43